Seja nos filmes de ficção científica ou no seio da imaginação popular, há uma tendência notável no mundo contemporâneo para se retratar e projectar a Inteligência Artificial (IA), e os seres animados por este modo de processamento, como vectores de um qualquer plano de dominação sobre o humano. Seja em que contexto for, a opacidade desta criação e a falsa neutralidade com que nos habituámos a observar e a debater a tecnologia, fá-la aparecer sempre num plano superior, impositivo, inquestionável e quase autoritário. E se, esta perspectiva, pensadores como Steven Pinker relacionam a uma projecção de uma perspectiva de macho-alfa sobre o conceito de inteligência, como se poderia projectar uma inteligência artificial feminista, ou o que se aprende nessa nessa tentativa?

Como outros fenómenos noutros momentos da história, a inteligência artificial projecta-se sobre a sociedade como algo demasiado complexo para ser percebido, quanto mais para ser criticado, ou repensado segundo diferentes perspectivas. O seu desenvolvimento incremental faz com que aquilo com que hoje convivemos seja resultado de décadas de diferentes trabalhos de investigação e programação, e o exercício da crítica tenha de passar por diversos domínios, mas não é só este detalhe que nos impede a clarividência sobre uma disciplina da tecnologia que se tornou uma forma de existência contemporânea com a qual convivemos todos os dias; que todos os dias muda as nossas vidas, mesmo que em muitos casos não nos apercebamos disso. Como exploro no ensaio publicado pelo Shifter, ‘Uma Questão de Inteligência’, parte da dificuldade é a forma como escolhemos falar deste tema, nomeando o conceito com uma justaposição composta por dois conceitos altamente ambíguos.

Perceber a inteligência artificial e as suas particularidades passa necessariamente por mitigar a ambiguidade dos conceitos, e de uma forma metódica, sistematizar os processos que a tornam como é. Um pouco como em Ecce Homo, Nietzsche procura respostas para a forma como chegou a ser o que foi, na ampla teia de relações e coincidências que foi a sua vida, é preciso destrinçar com rigor todo o aparato que culmina nas formas em que vamos vendo esta tecnologia chegar ao contacto com a humanidade. E se, superficialmente, este exercício se podia resumir a um plano conceptual, das ideias e dos significados, uma perspectiva materialista revela um manancial de relações indispensáveis a uma compreensão. Afinal de contas, por muito que os diferentes componentes de uma IA sejam virtuais, a Inteligência Artificial não deixa de ser uma máquina, um objecto, ou conjunto de objectos, que se anima por relação entre os seus componentes – e o estudo da inteligência nestes sistemas há muito que ocupa pensadores de todas as áreas, num esforço concertado que deixa clara a necessidade de não só reflectir sobre os efeitos visíveis do fenómeno, mas também sobre as relações que lhe dão origem; um exercício que pode não só fornecer pistas para conferir um maior rigor à máquina, como também, em sentido inverso, ajudar-nos a perceber a forma como a máquina humana funciona – mas deixemos essa componente para outras análises.

O estudo da inteligência artificial enquanto sistema, e a sua análise de uma perspectiva quase cirúrgica – prestando atenção a cada detalhe –, não é um tema propriamente novo. Com a proliferação dos sistemas equipados com estes mecanismos e a popularização do termo sob a falsa égide da neutralidade, o tema tornou-se urgente. Já não são só investigadores, académicos, programadores e pensadores impactados pelos viés e preconceitos carregados pela ambiguidade do nome; agora são pessoas, grupos e comunidades que se vêem ora afectados pelas operações levadas a cabo por esta forma de inteligência, ora envolvidos precariamente no gigante sistema que lhe dá origem. Se outrora trabalhos como os de Alison Adam, Artificial Knowing: gender and the thinking machine (1998) e Embodying Knowledge: A Feminist Critique of Artificial Intelligence (1995) forneceram pistas essenciais para um entendimento diferenciado da inteligência artificial – denunciando a subjectividade dos conceitos base, como inteligência ou conhecimento, a partir de uma epistemologia feminista inspirada em autoras como Donna Haraway ou Sherry Turkle – hoje o caminho iniciado por essa análise conduz necessariamente a uma dissecação materialista do fenómeno, na mesma medida em que durante as últimas décadas a IA viu as suas materializações multiplicarem-se, assumindo as mais diversas formas e os mais importantes papéis na vida quotidiana.

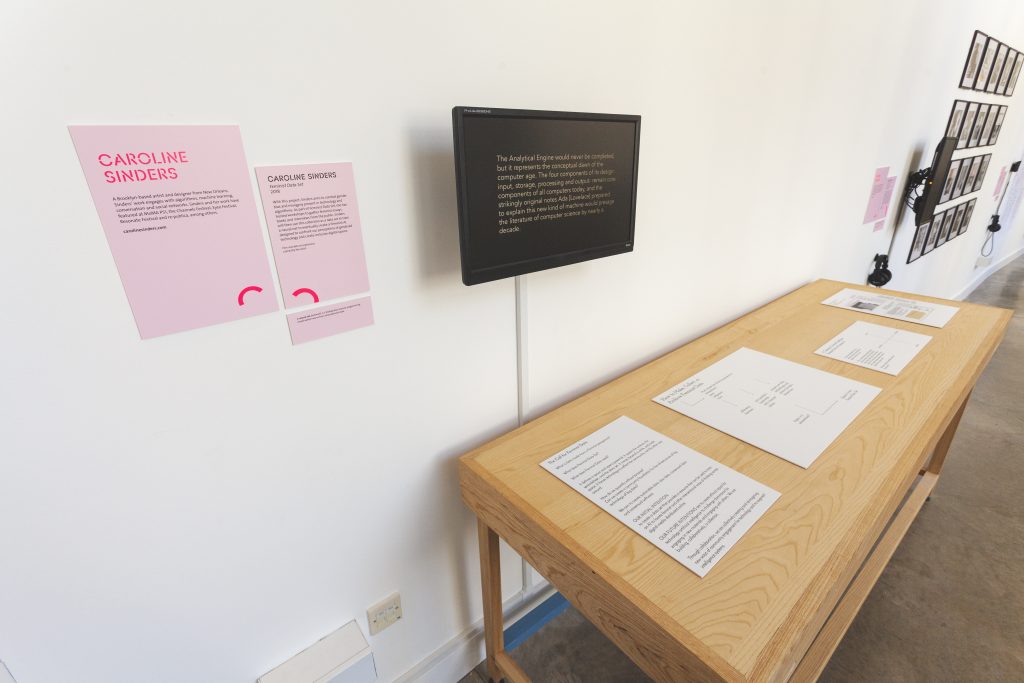

À medida que o humano se relaciona cada vez mais com terminais, e a relação do humano com o mundo é intermediada por aparelhos tecnológicos, a inteligência artificial, enquanto conceito lato, torna-se numa espécie de complexo industrial, sustentando-se numa série de relações económicas – para além das históricas e conceptuais que lhe são anteriores. É sobre isso que incidem trabalhos como o de Kate Crawford, autora de The Atlas of AI: Power, Politics, and the Planetary Costs of Artificial Intelligence (2021), e co-autora do compreensiva infografia Anatomy of an AI System, trabalho em que em conjunto com Vladan Joler, Crawford traça todo um mapa de relações em torno de um Amazon Echo. Neste mapa anatómico é possível ganhar uma perspectiva mais ampla sobre o universo da Inteligência Artificial, desde a necessidade de extracção de metais pesados para as baterias que sustentam os aparelhos que correm os algoritmos de IA, passando pela necessidade de se treinarem os sistemas com dados e de todo o sistema ser posteriormente desenhado de forma a interagir de modo simples com o utilizador final. Na mesma linha situa-se o projecto de Caroline Sinders, Feminist Data Set, uma tentativa de concretização de um sistema de inteligência artificial segundo uma perspectiva feminista.

Construindo uma Inteligência Artificial Feminista

Sinders, artista e designer interessada em investigar sobre aprendizagem automática (machine learning) começou em 2017 este projecto que ainda mantém em aberto, em que de um modo exaustivo procura perceber como as práticas que dão origem a um sistema de Inteligência Artificial podem ser repensadas de uma perspectiva feminista. O processo, que passa por interrogar cada momento com uma consciência crítica, inicia-se desde logo na extração de minerais e fabrico de hardware. “Como se seria a extracção de minerais segundo uma perspectiva feminista? Ou a construção de um computador?” são algumas das questões que balizam o processo. Como explica a artista numa entrevista por e-mail, pensar neste domínio de uma perspectiva crítica não é só “pensar como recolhes a informação e como a introduzes no sistema”, embora essa também seja uma parte importante. “Não é só como treinas um algoritmo e que tipo de data coletas para treinar o algoritmo, é como dás cada passo e como abordas cada processo que está relacionado”, explica-nos, numa alusão à complexidade do sistema que resolveu questionar e dissecar. Uma complexidade que acabou por marcar o projecto, na medida em que para a artista se foi revelando como um fractal de questões interligadas – algo que dificultou a concretização de um suporte material, mas acabou por servir o propósito de promover um debate alargado. “O objectivo não é fazer disto um projecto infinito, é pôr as pessoas a pensar nestes pequenos processos e em como se articulam, no caso do meu projecto, no que toca à aprendizagem automática.” E isso faz-se respondendo sistematicamente a questões sobre como podia ser diferente o processo que culmina nos sistemas de Inteligência Artificial.

Um dos pontos mais importantes, embora como referido não seja o único, tem que ver com a forma como a data é recolhida e catalogada, de modo a servir como forma de treino dos sistemas automatizados, algo que serviu de inspiração ao projecto lateral de Sinders, Technically Responsible Knowledge (TRK). Neste projecto composto por uma calculadora hipotética e um ensaio, Sinders em conjunto com Cade Diehm e Ian Ardouin Fumat, pretendem alertar para a forma como o processo de desenvolvimento destes sistemas artificiais complexos depende muitas vezes de trabalhadores extremamente mal pagos. A calculadora convida o utilizador a orçamentar o seu trabalho como catalogador de um set de dados para Inteligência Artificial, expondo a forma como este trabalho é, quase sempre, subvalorizado. Plataformas como o Mechanical Turk (Amazon), CrowdFlower ou Fiverr, são como se lê no ensaio do projecto são “verdadeiramente o cérebro humano oculto na fachada da inteligência da máquina”, colocando centenas de milhares de pessoas das mais distantes zonas do mundo a trabalhar para empresas, muitas delas norte-americanas, com custos muito abaixo do praticado no mercado comum. A catalogação de imagens que serve para que a máquina possa saber o que é um barco ou um carro é, assim, mais uma tarefa entregue a trabalhadores precários, sem qualquer vínculo laboral que lhes garanta direitos. Pelo contrário, os trabalhadores competem por conseguir os pequenos trabalhos, muitas vezes vendo-se obrigados a baixar ainda mais os seus preços. A título de exemplo, o salário mínimo em Washington, onde está registada a Amazon é de 11 dólares por hora, enquanto que, a média de vencimento no Mechanical Turker era, em 2018, cerca de 2 dólares por hora, como se lê no ensaio. Uma diferença assinalável e que revela o modo de actuação das empresas de tecnologia e o modelo de desenvolvimento do capitalismo actual. Se em indústrias como a moda, o problema da concentração de mão de obra em zonas com baixa proteção laboral já se fazia sentir, o desenvolvimento tecnológico não parece ter escolhido uma via diferente, espoletando um debate muito mais alargado, sobre o papel do humano no mundo da data – uma discussão que retoma a perspectiva ontológica com que se inicia o artigo.

O que podemos aprender ao questionar a tecnologia?

“Eu acho que as pessoas são desumanizadas quando as colocamos todas num documento, sem qualquer contexto, assumindo que protegemos as suas identidades mas sem o conseguirmos fazer” diz-nos, encadeando na reflexão na relação ambígua que se estabelece entre os utilizadores e a informação que geram. Para Sinders as pessoas deviam pensar na data como um “material precioso” em vez de “como algo que é inesgotável, que existe sempre e que se pode sempre criar”, um pensamento contra-intuitivo que convida a uma perspectiva mais crítica e consciente não só do que fazemos online mas também das informações que para lá produzimos e que por lá deixamos. No livro Capital is Dead, McKenzie Wark aponta à evolução do capitalismo digital esta relação perversa de desvalorização crescente da informação, ao ponto de todos os utilizadores de redes sociais serem, em última instância, os seus únicos produtores do conteúdo sem que recebam nada em troca, para além da possibilidade de poderem usar os serviços.

Sinders não vai tão longe na nossa conversa, mas aponta à complexidade dos sistemas tecnológicos a dificuldade em assumirmos posturas mais críticas. “Acho que estamos integrados em sistemas que são impossíveis de mapear e impossíveis de entender na sua total complexidade, porque estão sempre a mudar. Se eu tivesse de desenhar um mapa de como certa pessoa chegou a certa informação, esse mapa poderia mudar consoante a localização da pessoa, o histórico de localização. E isso não é culpa das pessoas, mas das empresas”, sugere, relacionando esta complexidade incremental à proliferação dos algoritmos em funções de intermediação entre o humano e o real, ou mesmo entre o humano e o outro. “Eu acho que as redes sociais criam uma falsa simplificação da realidade, não muito diferente do que acontecia com a rádio e a televisão O que é dificil neste caso é que os contextos colapsaram. As redes sociais, como toda a tecnologia, são muito constritas, mas nós tendemos a esquecer-nos disso (…) esquecemo-nos que vivemos num mundo hiper-desenhado e hiper-constrito, que não podemos de facto mudar” refere Sinders, numa resposta que lembra a percepção de falsa neutralidade na tecnologia acima descrita. Uma percepção errónea e que pode prejudicar os indivíduos, ao perderem noção de qual o seu espaço de acção, o que realmente podem impactar, como podem fazer a diferença no seu contexto.

E se este é um problema das empresas, como aponta Sinders, a resolução pode bem passar pelos profissionais que materializam os projectos – e, claro está, por uma perspectiva feminista, que cruze diferentes sensibilidades, para além do cliché do design centrado no humano. “Concordo com o que diz o professor Ahmed Ansari, de que o design precisa da antropologia para que possam assimilar nos seus designs noções de pluralidade e contexto local”. Até lá, é importante continuar a promover uma maior compreensão dos sistemas tecnológicos, aumentando a objetividade da percepção desenvolvida pelos seus utilizadores, tornando mais claras e sobretudo mais justas as relações que lhe estão adjacentes. Pensar um sistema de Inteligência Artificial é, assim, mais do que uma proposta concreta, um exercício de pensamento muito útil a uma compreensão aprofundada da tecnologia.

[infobox]Este artigo faz parte de uma trilogia sobre tecnologias de ponta e a sua relação com a sociedade abordada de uma perspectiva crítica e contra-intuitiva. Na Revista #3 podes encontrar uma entrevista sobre algoritmos e o seu potencial decolonial com Abdo Hassan.[/infobox]

You must be logged in to post a comment.